ChatGPTのセキュリティリスクとは?企業が実施すべき対策と設定手順

公開日:2026年03月11日

この記事に書いてあること

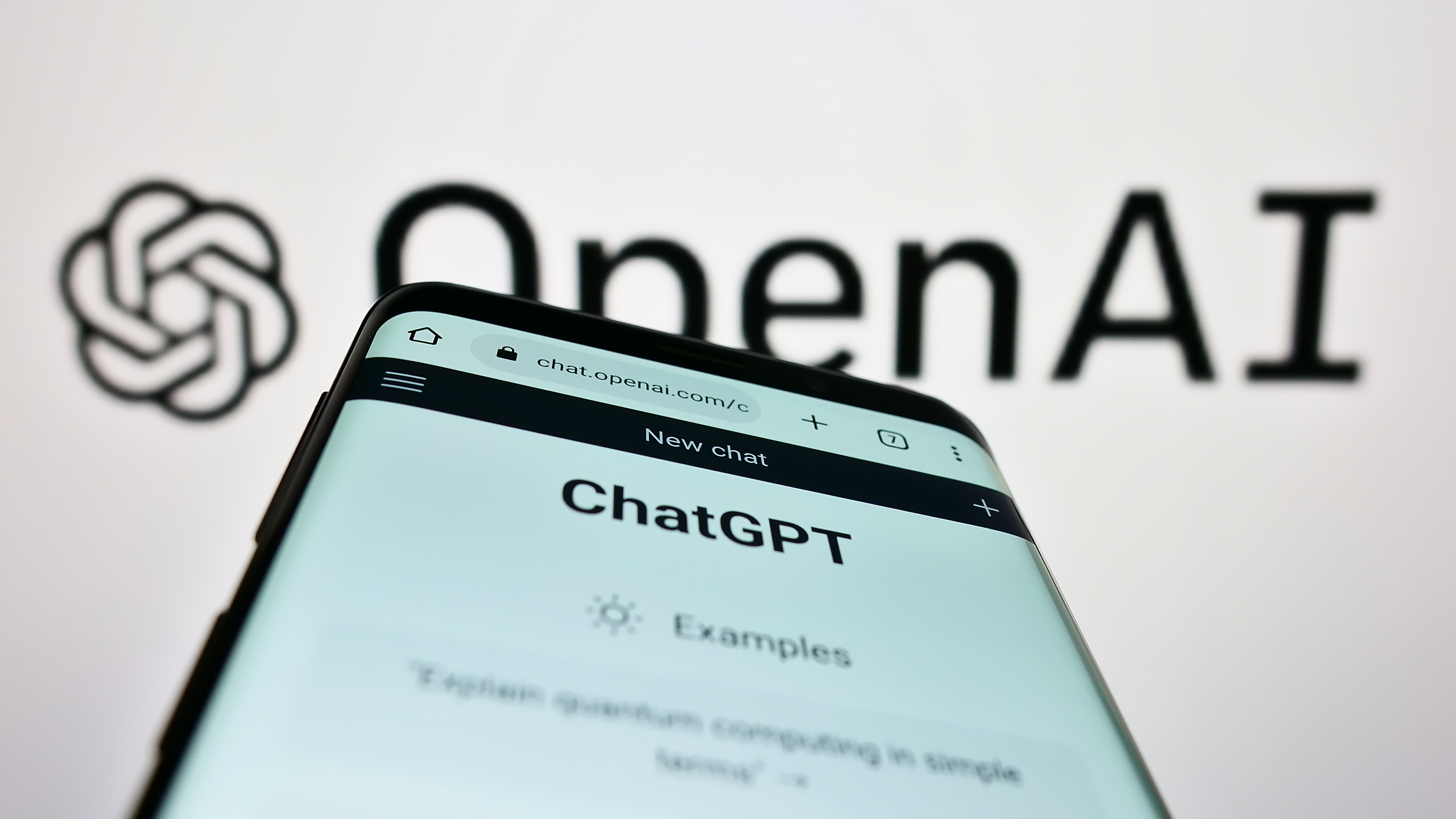

ChatGPTは業務効率を飛躍的に高めるツールとして注目されていますが、その一方で「入力した情報が漏れるのではないか」というセキュリティへの不安を抱えている方も多いのではないでしょうか。特に企業での利用においては、たった一度の不注意が重大な情報漏洩につながるリスクがあるため、慎重な運用が求められます。

この記事では、ChatGPTを安全にビジネス活用するために知っておくべきリスクの正体と、今すぐできる具体的な対策や設定手順について分かりやすく解説します。読み終える頃には、自社に必要なセキュリティ対策が明確になり、安心して導入を進めるための準備が整うはずです。

ChatGPTに潜むセキュリティリスクとは?

企業がChatGPTを導入する際、最も懸念されるのがセキュリティに関するリスクです。便利なツールである反面、仕組みを正しく理解していないと思わぬ形で情報が外部に渡ってしまう可能性があります。

ここでは、具体的にどのようなリスクが存在するのか、その仕組みと影響について解説します。

【関連記事】セキュリティ教育とは | 中小企業応援サイト | RICOH

入力したデータがAIの学習に再利用される仕組み

ChatGPTの無料版や個人向けの有料プラン(Plus)では、ユーザーが入力したデータがAIモデルの学習に利用される仕様になっています。これは、入力されたテキストの内容がOpenAI社のサーバーに保存され、将来的な回答精度の向上やシステム改善のために使われる可能性があるということです。

たとえば、社員が業務日報や会議の議事録などをそのままチャットに入力してしまうと、その内容がAIの知識として吸収されてしまう恐れがあります。その結果、まったく関係のない別のユーザーが関連する質問をした際に、学習された情報に基づいた回答が生成されてしまうリスクがゼロではありません。意図せずして自社のノウハウや内部事情をAIに教えてしまっている状態になるため、この「学習される」という仕様は企業利用における最大のリスク要因といえます。

|

プラン |

学習への利用 |

備考 |

|

無料版 |

あり(デフォルト) |

設定でオフにすることが可能 |

|

Plus(個人有料) |

あり(デフォルト) |

設定でオフにすることが可能 |

|

Business/Enterprise |

なし(デフォルト) |

企業向けプランは学習されない |

|

API利用 |

なし(デフォルト) |

システム組み込み等は学習されない |

機密情報や個人情報が外部へ流出する可能性

入力データが学習されるだけでなく、ChatGPTを利用する環境そのものにも情報漏洩のリスクは潜んでいます。もし社員が顧客の氏名や住所、あるいは未発表の新製品情報などをプロンプト(指示文)に入力してしまった場合、そのデータはクラウド上のサーバーに送信されます。一般的なクラウドサービスと同様に通信は暗号化されていますが、入力した時点で情報は社内の管理下を離れ、外部のプラットフォームに預けられることになります。

また、過去にはチャット履歴が他のユーザーに見えてしまうバグが発生したこともあり、システム自体の不具合によって情報が露呈する可能性も完全に否定することはできません。したがって、どのような情報なら入力しても安全で、どのような情報は絶対に入力してはいけないのかという明確な線引きがなければ、いつの間にか重大な機密情報が社外へ流れ出してしまう危険性があるのです。

誤情報の生成や著作権侵害につながる法的リスク

セキュリティリスクは情報の流出だけにとどまりません。ChatGPTが生成する回答には、事実とは異なる誤った情報(ハルシネーション)が含まれることがあります。もし社員が生成された内容を検証せずにそのまま対外的な資料や顧客への回答に使ってしまった場合、企業の信用問題に発展する恐れがあります。

さらに、生成された文章やコードが、既存の著作物と酷似しているケースも稀に存在します。知らずにそれを商用利用してしまうと、著作権侵害として他社から訴えられる法的リスクも考えられます。つまり、入力する際のリスクだけでなく、出力された情報をどう扱うかという点においても、企業を守るためのリテラシーと管理体制が必要不可欠なのです。

実際に報告されているセキュリティ事故の事例

ChatGPTのリスクは理論上のものではなく、実際に世界中でいくつかのセキュリティインシデントが発生しています。他社の失敗事例を知ることは、自社の対策を考える上で非常に重要な教訓となります。

ここでは、過去に実際に起きた具体的な事故のケースを紹介します。

【関連記事】サイバー攻撃の最新動向と企業が講じるべき対策10選 | 働き方改革ラボ | リコー

2023年3月のチャット履歴漏洩インシデント

2023年3月20日、OpenAI社はオープンソースライブラリのバグにより、一部ユーザーが他のアクティブユーザーのチャット履歴タイトルを閲覧できる状態になったことを公式に発表しました。

さらに深刻なことに、ChatGPT Plusの有料会員1.2%について、同日午前1時から10時(太平洋時間)の9時間の間に、氏名、メールアドレス、クレジットカードの下4桁などの決済情報が他のアクティブユーザーに表示される可能性がありました。OpenAI社はサービスを一時停止してバグを修正し、影響を受けた可能性のあるユーザーに直接通知を行っています。

2025年11月のMixpanelセキュリティインシデント

2025年11月9日、OpenAI社が利用していたデータ分析プロバイダーMixpanel社のシステムが不正アクセスを受け、一部のユーザー情報が流出しました。OpenAI社は11月25日にMixpanelから影響を受けたデータセットの共有を受け、公式発表を行いました。

流出した可能性のある情報には、APIユーザーおよび一部のChatGPTユーザーの氏名、メールアドレス、おおよその位置情報、使用ブラウザ情報などが含まれます。OpenAI社は直ちにMixpanelを本番環境から削除し、影響を受けた組織と個人ユーザーに通知を実施しました。

イタリアのデータ保護当局によるGDPR違反認定と制裁措置

2024年12月20日、イタリアのデータ保護当局(Garante)は、OpenAI社がChatGPTの運営において個人データ保護規則(GDPR)に違反していたと認定し、1500万ユーロ(約24億円)の制裁金を科すことを公式に発表しました。

同当局は、OpenAI社が2023年3月に発生したデータ侵害を当局に通知しなかったこと、ユーザーデータの取り扱いにおける透明性の欠如、未成年者の年齢確認メカニズムの不備を指摘しました。さらにOpenAI社に対し、6ヶ月間にわたる公衆啓発キャンペーンの実施を命じています。

情報漏洩を防ぐための具体的な設定手順

リスクや事例を理解した上で、次に重要なのは「どうすれば防げるのか」という具体的なアクションです。幸いなことに、ChatGPTにはユーザー自身でセキュリティを高めるための設定が用意されています。

ここでは、今すぐ実施できる設定手順を紹介します。

|

設定項目 |

目的 |

手順の概要 |

|

オプトアウト |

学習利用の拒否 |

設定>データコントロール>モデル改善をオフ |

|

一時的なチャット |

履歴の非保存 |

チャット画面メニュー>一時的なチャットを選択 |

|

多要素認証(MFA) |

乗っ取り防止 |

設定>多要素認証>認証アプリでQR読込 |

データを学習させないオプトアウト設定の方法

入力したデータがAIの学習に使われないようにするためには、ChatGPTの「データコントロール」設定から、モデル改善へのデータ提供を停止する必要があります。この設定を行うことで、設定後に入力した会話内容が、OpenAIによるモデルのトレーニングに利用されることはなくなります。

ブラウザ版のChatGPTでは、画面内のメニューから「設定(Settings)」を開き、「データコントロール(Data controls)」に関する項目を確認します。そこに表示される、ChatGPTの品質向上を目的としたデータ提供に関する設定をオフにすることで、学習への利用を拒否できます。

なお、この設定は今後の会話を対象としたものであり、設定変更前に入力した内容については、すでに学習用途として処理されている可能性があります。企業でChatGPTを利用する場合は、全社員に対してこの設定を必須とし、あわせて入力してよい情報の範囲を明確に定めることが、情報漏洩対策の第一歩となります。

チャット履歴を残さない機能を活用する手順

さらに安全性を高めたい場合は、チャット履歴そのものを保存しない設定を利用することも可能です。以前は学習をオフにすると履歴も残らない仕様でしたが、現在は「一時的なチャット(Temporary Chat)」という機能として提供されています。チャット画面の上部にあるモデル選択メニューなどからこのモードを有効にすると、その会話は履歴に保存されず、ブラウザを閉じれば消えてしまいます。

機密性の高い内容を扱う際や、履歴に残す必要のない壁打ち相手として利用する際には、この機能を活用することで、万が一アカウントに不正アクセスされた場合でも情報が盗まれるリスクを減らすことができます。用途に応じて、履歴を残す通常のチャットと使い分ける運用を推奨します。

多要素認証を有効化してアカウントを守る方法

アカウントの乗っ取りを防ぐためには、多要素認証(MFA)の設定が不可欠です。OpenAIのアカウント設定画面から、多要素認証を有効にすることができます。これを設定すると、ログイン時にIDとパスワードだけでなく、スマートフォン等の認証アプリに表示されるワンタイムコードの入力が必要になります。

仮にパスワードが流出しても、手元の認証デバイスがなければログインできないため、不正アクセスの被害を食い止めることができます。特にクレジットカード情報を登録している有料プランのアカウントや、業務で重要なデータを扱っているアカウントでは、必ずこの設定を有効にしておくべきです。

企業が安全に活用するための運用ルール

個人の設定だけでは、組織全体のセキュリティを維持するには限界があります。企業としてChatGPTを安全に使い続けるためには、システム的な対策と運用ルールの両輪が必要です。ここでは、組織として取り組むべき対策について解説します。

【関連記事】人的セキュリティ対策とは?「人」が原因の情報リスクとその対策を解説 | 働き方改革ラボ | リコー

API版や法人向けプランの導入を検討する理由

従業員の個別の設定ミスを防ぎ、組織として統制を効かせるためには、法人向けプラン(ChatGPT BusinessやEnterprise)やAPI版の導入が推奨されます。これらのプランでは、デフォルトで入力データが学習に利用されない仕様になっており、契約によってデータの機密性がより強固に保証されています。

また、管理者機能が充実しているため、誰がいつ利用しているかを管理したり、セキュリティ設定を組織全体で統一したりすることも可能です。無料版や個人プランを業務利用させることはリスク管理の観点から推奨できないため、コストはかかりますが、情報漏洩事故が起きた際の損害を考えれば、法人プランへの移行は合理的な投資といえます。

社内利用ガイドラインで定めるべき禁止事項

ツールを導入するだけでなく、従業員が迷わず判断できるような利用ガイドラインを策定することも重要です。ガイドラインには、具体的に「入力してはいけない情報」を明記する必要があります。たとえば、個人情報(氏名、電話番号等)、機密情報(未公開の売上データ、パスワード、ソースコード等)、顧客や取引先に関する非公開情報は入力禁止と定めます。

また、生成された情報の取り扱いについても、ファクトチェックを義務付けることや、著作権への配慮を求めるといったルールを盛り込みます。抽象的な表現ではなく、「会議の議事録を入れる際は固有名詞を伏せること」といった具体的な行動基準を示すことで、現場での事故を未然に防ぐことができます。

従業員へのセキュリティ教育を実施する重要性

どれほど素晴らしいシステムやルールを作っても、それを使う人間がリスクを理解していなければ効果は半減します。そのため、定期的なセキュリティ教育の実施が欠かせません。ChatGPTの仕組みやリスクについて解説する研修を行ったり、実際に起きた事故事例を共有したりすることで、従業員のリテラシーを向上させることが大切です。

特に、「なぜその情報を入力してはいけないのか」という理由を納得感のある形で伝えることで、ルールを守る意識が高まります。新しい技術は日々進化しているため、一度きりの教育ではなく、継続的に最新情報を発信し続ける体制を作ることが、長期的な安全確保につながります。

まとめ

この記事では、ChatGPTのセキュリティリスクと企業が取るべき対策について解説しました。要点は以下の通りです。

- ・入力データはデフォルトでAIの学習に利用されるため、オプトアウト設定や法人プランで保護する必要がある。

- ・サムスン電子の事例などのように、従業員の安易な入力が機密情報の流出につながるリスクが現実に存在する。

- ・企業として安全に使うには、個人情報の入力禁止などのガイドライン策定と、継続的な社員教育が不可欠である。

ChatGPTは正しく対策すれば、企業の生産性を大きく向上させる強力な武器となります。リスクを恐れて遠ざけるのではなく、適切な設定とルール作りを行うことで、安全で効果的なAI活用を実現してください。

ChatGPTの社内活用において、セキュリティや管理体制に不安を感じていませんか。一般的なChatGPTとの違いや、安心安全に利用するための特長・メリットをまとめた資料がダウンロードできます。運用の懸念を解消するために、ぜひお役立てください。

記事執筆

働き方改革ラボ 編集部 (リコージャパン株式会社運営)

「働き方改革ラボ」は、”働き方改革”が他人ゴトから自分ゴトになるきっかけ『!』を発信するメディアサイトです。

「働き方改革って、こうだったんだ!」「こんな働き方、いいかも!」

そんなきっかけ『!』になるコンテンツを提供してまいります。新着情報はFacebookにてお知らせいたします。

記事タイトルとURLをコピーしました!